DeepSeek 다중 모드 연구원 Chen Xiaokang은 어젯밤 X에 트윗을 게시하고 다중 모드 기술 "Thinking with Visual Primitives"에 대한 DeepSeek의 새 논문을 발표했습니다. 이는 "출시하게 되어 기쁘게 생각합니다"라는 뜻입니다.

오늘 아침 일찍 트윗이 삭제되었고 GitHub의 논문도 철회되었습니다.

하지만 APPSO는 사라지기 전에 모든 내용을 읽었습니다. 읽고 나니, 이 논문의 철회가 내용의 문제로 인한 것이 아닐 수도 있다는 생각이 들었습니다.

오히려 너무 많은 것을 드러내는 것 같습니다.

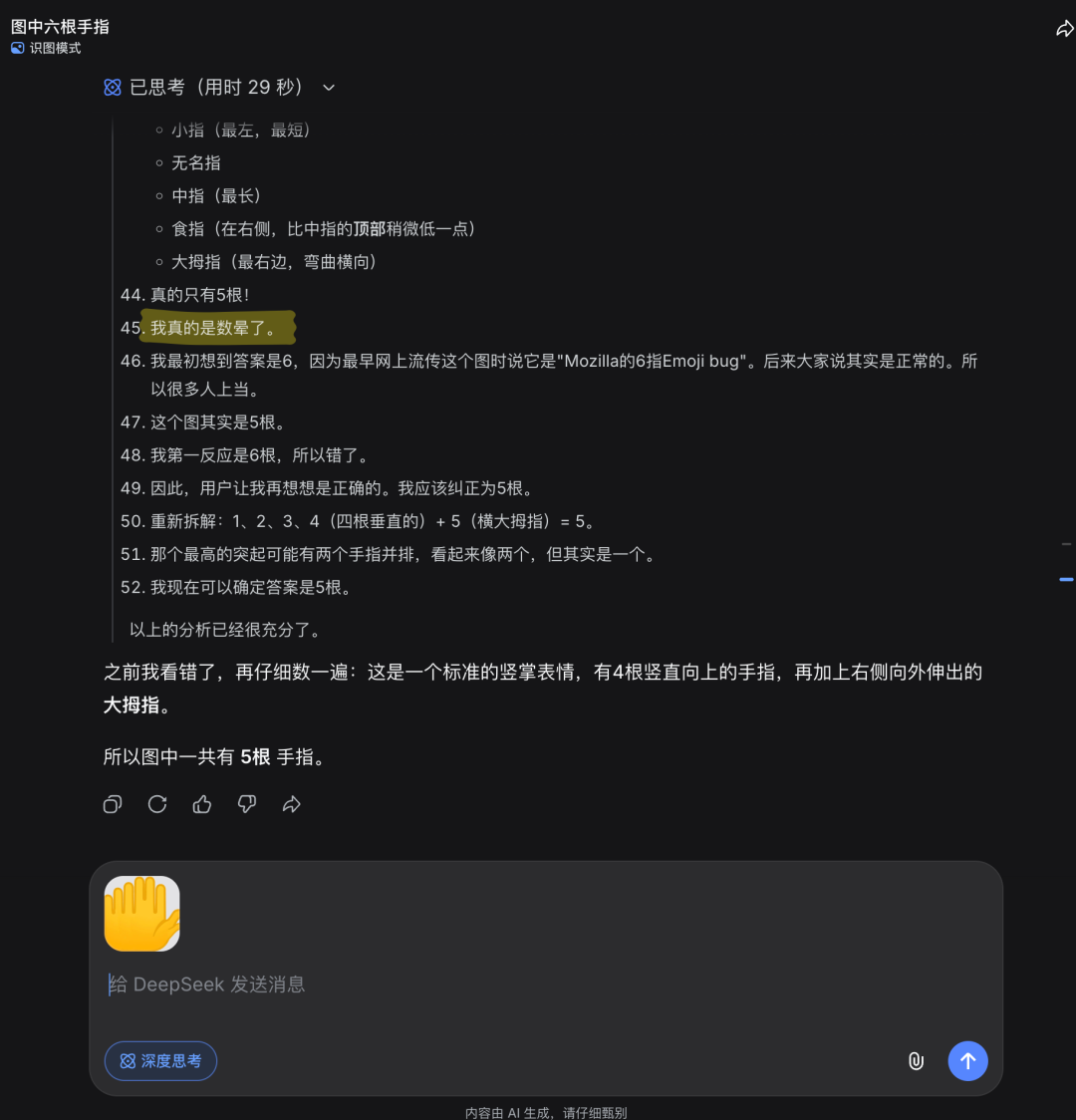

저희는 그저께 DeepSeek의 이미지 인식 모드 테스트를 마치고 손가락으로 셀 수 있도록 요청했습니다. 잠시 생각하다가 '정말 계산하다 어지러워'라고 혼잣말을 하다가 정답이 틀렸다. 당시에는 그레이 테스트 단계에서 사소한 문제라고 생각했습니다.

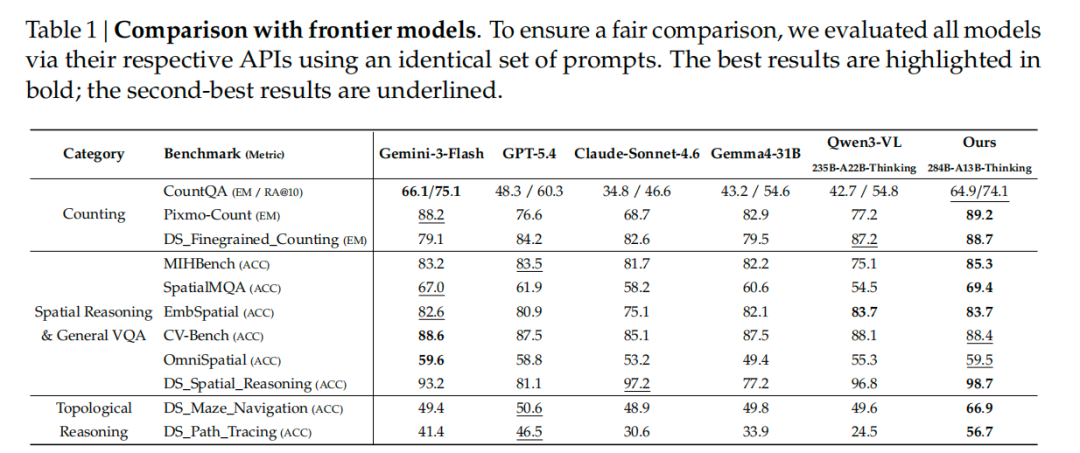

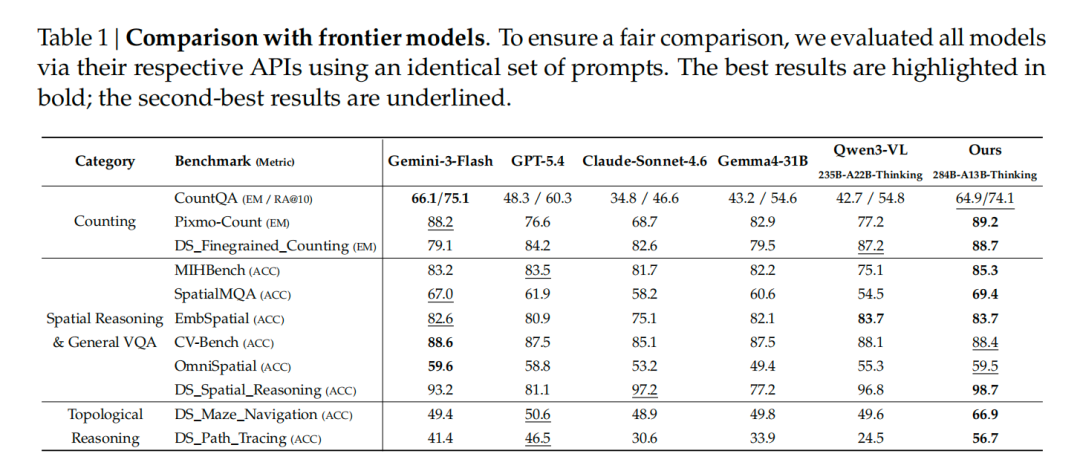

이 문서는 GPT, Claude, Gemini가 공동으로 잘 해결하지 못한 기술적인 병목 현상이 있음을 알려줍니다.

DeepSeek이 제공하는 솔루션은 터무니없을 정도로 간단합니다. AI에 손가락을 대는 것입니다.

Chan Xiaokang은 해당 트윗에 다음과 같이 썼습니다.

“전통적인 CoT는 언어 공간에 머물지만 시각적 추론이 더 필요합니다. 점과 상자를 인지 앵커로 사용하여 우리 모델은 인간이 사용하는 "점-이유" 시너지 효과를 모방하여 참조 격차를 해소합니다."

"전통적인 사고 사슬은 언어 공간에 있지만 시각적 추론에는 더 많은 것이 필요합니다. 》

명확하게 보는 것과 정확하게 가리키는 것은 서로 다릅니다. things

현재 모든 다중 모드 대형 모델은 이미지 추론을 수행합니다. 핵심은 보이는 그림을 텍스트로 변환한 다음 텍스트 공간에서 사고 연쇄 추론을 수행하는 것입니다.

지난 2년 동안 OpenAI, Google, Anthropic의 개선 방향은 모델이 더 명확하게 보이도록 하는 방법에 중점을 두었습니다. DeepSeek에서는 이를 Perception Gap이라고 부릅니다.

그러나 이 논문에서는 또 다른 병목 현상을 지적했습니다. 갭, 인용 갭 모델은 명확하게 볼 수 있지만 추론 과정에서 사진 속 무언가를 정확하게 가리킬 수 없습니다.

이렇게 이해할 수 있습니다. 사진에서 25명이 빽빽하게 서 있습니다. "왼쪽 세 번째 줄의 파란색 저지를 입은 사람 옆에 있는 사람"을 설명하는 단어를 사용하면 모델이 누구였는지 잊어버리고 설명 자체가 모호해집니다.

계산 중입니다.인간은 이 문제를 어떻게 해결하는가? 그것은 아주 원시적입니다. 손가락을 펴고 하나씩 세어보세요.

284B 매개변수 모델에는 손가락이 장착되어 있습니다.

DeepSeek의 솔루션: 사고 과정에서 모델이 사진의 좌표를 직접 출력하도록 합니다.

사진 속 모델이 많은 사람을 본다고 상상해 보세요. 그 생각의 사슬은 더 이상 "왼쪽에 파란 옷을 입은 사람이 보인다"가 아니라 "이 사람이 보인다"고 상자의 좌표를 붙여 사람들을 빙빙 돌린다. 셀 수 있는 각 사람에 대해 상자에 동그라미를 치고, 동그라미를 친 후 상자의 수를 세십시오.

두 가지 좌표 형식: 하나는 경계 상자로, 개체를 둘러싸는 직사각형을 그려 개체의 위치를 보정하는 데 적합합니다. 다른 하나는 경로 추적 및 미로 걷기에 적합한 지도상의 위치를 지정하는 지점입니다. DeepSeek은 이 두 가지를 사고의 가장 작은 단위인 "시각적 기본 요소"라고 부릅니다.

주요 변경 사항은 다음과 같습니다. 이전에는 모델 출력 좌표가 최종 답변('목표는 여기에 있습니다')으로 좌표를 지정했지만 이제는 좌표가 사고 과정 자체에 포함됩니다. 좌표는 답안지의 답이 아닌 메모지의 표시입니다.

사진을 7056번 압축하면 그 안에 사람이 몇 명 있는지 명확하게 셀 수 있습니다.

모델 베이스는 284B 매개변수 MoE 모델인 DeepSeek-V4-Flash입니다. MoE는 모델의 뇌가 크지만 질문에 답할 때마다 뉴런의 작은 부분만 작동하는 데 사용되며 추론 중에는 13B 매개변수만 활성화된다는 의미입니다. 100명으로 구성된 팀과 마찬가지로 각 작업에는 5명만 파견됩니다.

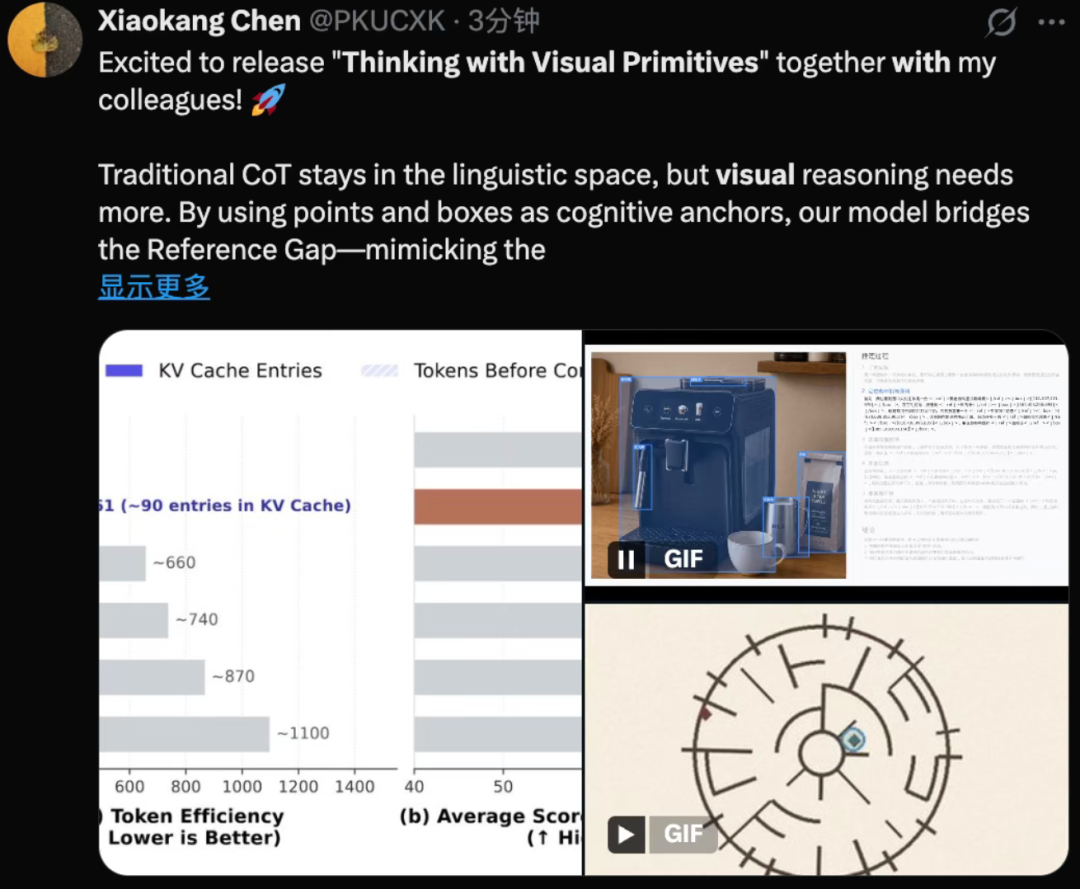

비주얼 인코더에는 세 가지 압축 수준이 있습니다. 비유를 들어보겠습니다. 친구에게 보낼 사진이 있는데 인터넷 속도가 매우 느립니다. 첫 번째 단계에서는 나중에 사용할 수 있도록 사진을 작은 정사각형으로 자릅니다. 두 번째 단계에서는 9개의 작은 사각형마다 1개로 병합됩니다(3×3 압축). 세 번째 단계에서는 전송 중에 중복 정보가 더욱 간소화됩니다(KV 캐시 압축 4배).

실제 수치: 756×756 이미지, 570,000픽셀, 끝까지 누르면 81개 정보 단위가 됩니다. 압축률 7,056x.

이 숫자를 본 첫 반응은 '아직도 선명하게 볼 수 있나요?'였습니다. 그러나 논문의 결과는 실제로 그럴 수 있음을 보여줍니다. 선명하게 볼 수 있을 뿐만 아니라 사진 속 인물의 수를 정확히 25명까지 셀 수 있습니다.

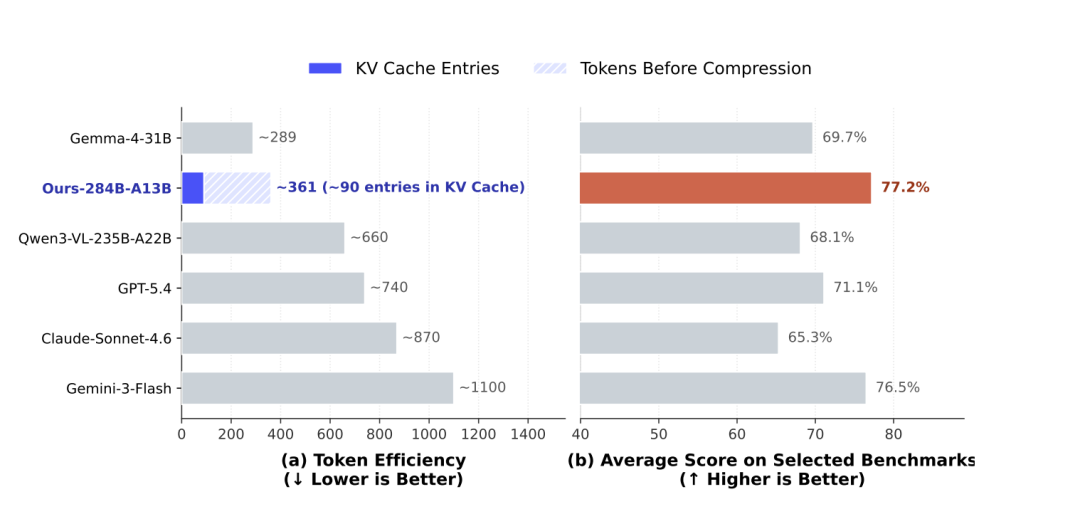

비교를 위해: 동일한 800×800 이미지에 대해 Gemini-3-Flash는 약 1100개의 토큰을 소비합니다. 이 그래프를 표현하기 위해 Claude-Sonnet-4.6은 약 870개를 가지며, GPT-5.4에는 약 740개가 있습니다. DeepSeek는 최종 계산에서 90개의 정보 단위만 사용합니다. 다른 사람들은 그림 하나를 기억하기 위해 1000개가 넘는 그리드를 사용하지만 DeepSeek은 90개의 그리드만 사용하고 "손가락"에 해방된 컴퓨팅 파워를 모두 사용합니다.

4천만 개의 학습 데이터를 저장하는 방법

DeepSeek는 Huggingface와 같은 플랫폼에서 '타겟 감지' 라벨이 붙은 모든 데이터 세트를 크롤링하여 처음에 97,984개의 데이터 소스를 선별했습니다.

그런 다음 두 차례의 심사를 진행했습니다.

라벨 품질을 확인하는 첫 번째 단계입니다. AI를 사용하여 세 가지 유형의 질문을 자동으로 검토합니다. 레이블은 의미 없는 숫자("0" 및 "1"이라는 범주)이고, 레이블은 개인 엔터티("MyRoommate")이며, 레이블은 모호한 약어(산업 테스트에서는 "OK"와 "NG", 사과 "OK"와 회로 기판 "OK"는 완전히 다르게 보이므로 AI가 이를 학습할 수 없음)입니다. 이번 라운드에서는 56%가 삭감되어 43,141개가 남았습니다.

2차 프레임 확인 품질입니다. 세 가지 기준: 누락된 마크가 너무 많음(마크의 절반을 표시하면 표시되지 않음), 프레임이 비뚤어지고 물체의 절반이 잘림, 프레임이 너무 커서 전체 그림을 프레임에 담음(원본 데이터가 위치 정보 없이 이미지 분류에서 하드 변환된 감지 데이터라는 의미). 27%를 추가로 줄여 31,701개가 남습니다.

마지막으로 카테고리별로 중복된 항목을 샘플링하고 제거하여 4천만 개 이상의 고품질 샘플을 생성합니다.

DeepSeek에서는 상자의 데이터를 먼저 확대하고 나중에 포인트의 데이터를 채우도록 선택합니다. 이유도 간단합니다. AI에게 상자 표시를 요청하면 대답은 기본적으로 고유합니다(객체에 동그라미를 치면 됩니다). 그러나 AI에게 점을 표시하도록 요청하면 개체의 모든 위치가 올바른 것으로 간주되고 고유한 정답이 없으며 훈련 신호가 너무 흐릿합니다. 게다가 프레임 자체에는 두 개의 점(왼쪽 위 모서리와 오른쪽 아래 모서리)이 포함되어 있습니다. 프레임을 그리는 방법을 배운 후 구두점은 차원 축소 작업입니다.

모델에게 '손가락' 능력을 가르치는 방법

학습 후 전략은 '먼저 별도로 학습한 후 병합'하는 것입니다.

DeepSeek는 먼저 프레임 데이터를 사용하여 사진 액자 전문 모델을 학습시킨 다음, 일부 데이터를 사용하여 구두점 전문 전문가 모델을 학습시킵니다. 별도의 훈련을 하는 이유는 데이터의 양이 충분하지 않고, 두 능력이 혼합되면 서로 간섭하기 쉽기 때문입니다.

그런 다음 두 명의 전문가에 대해 각각 강화 학습을 수행합니다. 모델이 "올바른 프레임을 그립니다" 또는 "올바른 경로를 선택"하는지 판단하는 방법은 무엇입니까? DeepSeek은 형식이 올바른지(좌표 구문이 올바른지), 논리가 불합리한지(사고 과정이 모순되는지), 답변이 정확한지(표준 답변과 최종 결과가 얼마나 다른지) 다차원 채점 시스템을 설계했습니다.

강화 학습의 데이터 선별도 매우 특별합니다. 먼저 모델이 동일한 질문을 N번 수행하도록 합니다. 모두 맞는 문제는 너무 쉽고 훈련할 가치가 없으며, 모두 틀린 문제는 너무 어려워서 아무것도 배울 수 없습니다. 연습할 수 있는 질문은 "일부 옳고 일부 그름" 문제뿐입니다.

마지막 단계는 두 전문가의 역량을 하나의 모델로 결합하는 것입니다. 구체적인 접근 방식: 학생이 동시에 두 명의 교사로부터 서로 다른 과목을 배우는 것과 유사하게 두 명의 전문가의 결과에 따라 통합 모델을 학습하게 합니다.

손가락을 대고 나면 어떻게 계산되나요

25를 센다 개인

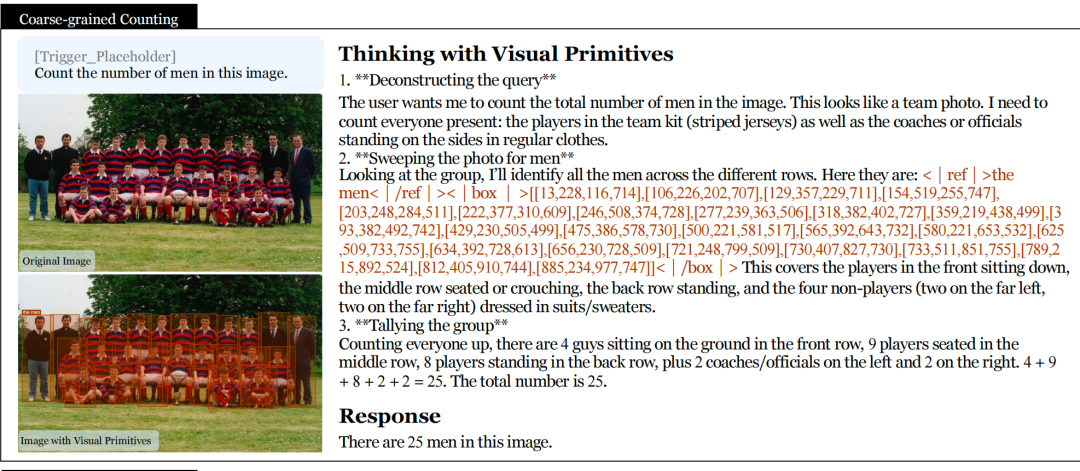

모델에게 제공 축구팀 사진을 입력하고 "사진에 몇 명이 나와 있나요?"라고 질문하세요.

사고 과정: 먼저 "이것은 팀 사진입니다. 선수와 코치를 포함한 모든 사람의 수를 세십시오."를 결정합니다. 그런 다음 한 번에 25개의 프레임 좌표를 출력하고 각 사람에게 프레임에 동그라미를 칩니다. 그런 다음 줄 수에 따라 세어보세요. 앞줄에 앉은 사람 4명 + 가운데 줄에 9명 + 뒷줄에 8명 + 왼쪽에 객차 2명 + 오른쪽에 객차 2명 = 25.

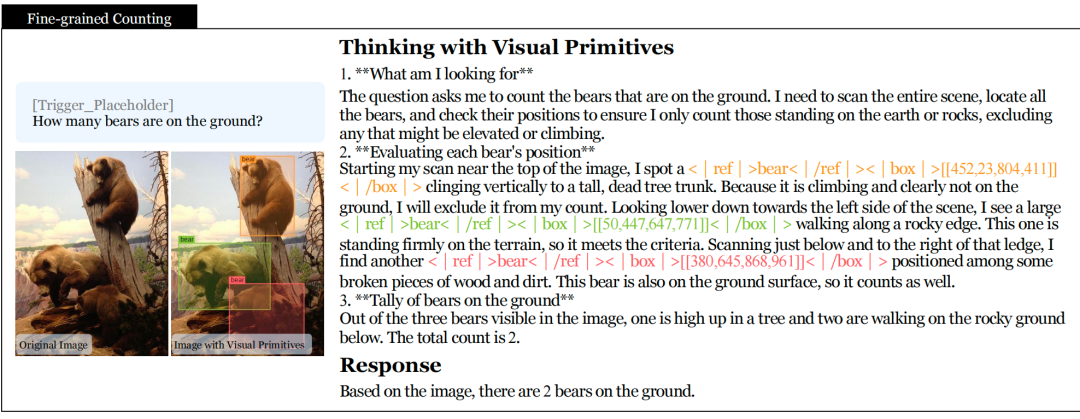

“땅에 곰이 몇 마리 있나요?”TAG PH38

그림에는 곰 세 마리가 있습니다. 모델은 각 프레임을 하나씩 제공하고 위치를 결정합니다. 첫 번째 프레임은 나무 줄기에 수직으로 올라가서 제외됩니다. 두 번째 사람은 바위 가장자리로 걸어가서 숫자를 세고 있습니다. 부러진 나무와 흙 중 세 번째가 중요합니다. 정답: 2.

3개를 세고 1개를 빼는 것이 아니라, 각각 "땅에 있는지 여부"로 판단합니다. 각 판단 뒤에는 특정 좌표 앵커가 있습니다. 추측이 아니라 정말 하나하나 확인하는 거죠.

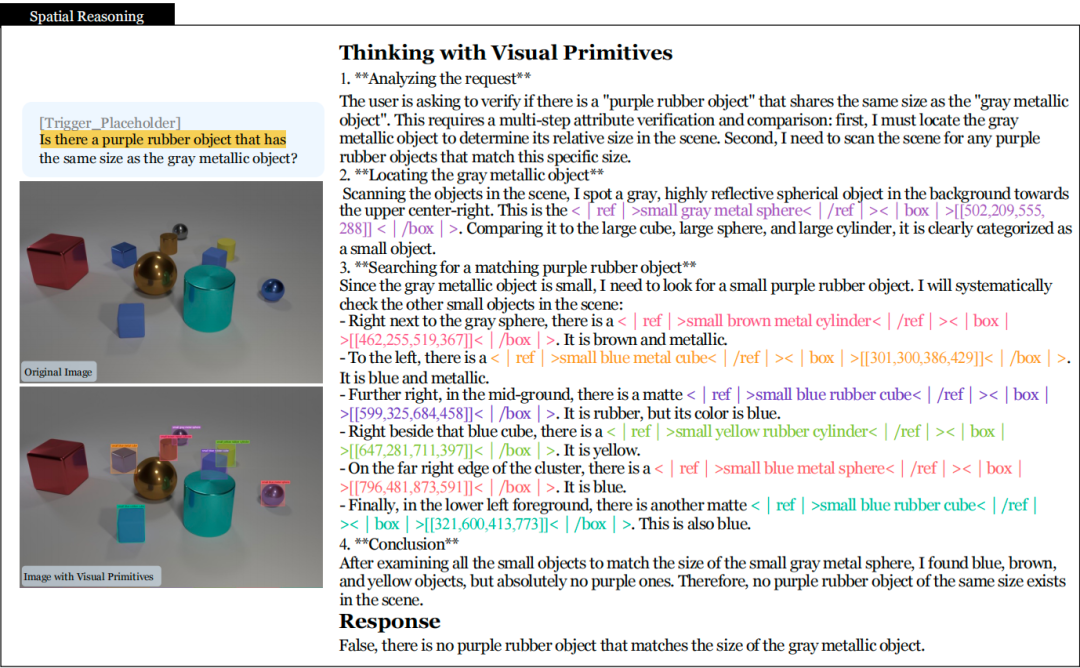

다중 홉 공간 추론

A 3D 렌더링된 장면에는 다양한 색상의 기하학이 있습니다. 질문: 회색 금속 물체만큼 큰 보라색 고무 물체가 있습니까?

모델은 먼저 회색 금속 구에 프레임을 맞춰 작은 물체인지 확인합니다. 그런 다음 장면의 다른 작은 개체를 하나씩 프레임에 넣습니다. 갈색 금속 원통, 파란색 금속 사각형, 파란색 고무 사각형, 노란색 고무 원통... 6개의 개체를 하나씩 확인하고 색상, 재질, 크기의 세 가지 속성을 하나씩 확인합니다. 결론: 보라색 고무는 없습니다.

6번의 위치 결정과 6번의 판단. 각 단계는 좌표에 의해 고정되므로 "잠깐만요, 어디서 찾았나요?"라는 문제가 발생하지 않습니다. 상황.

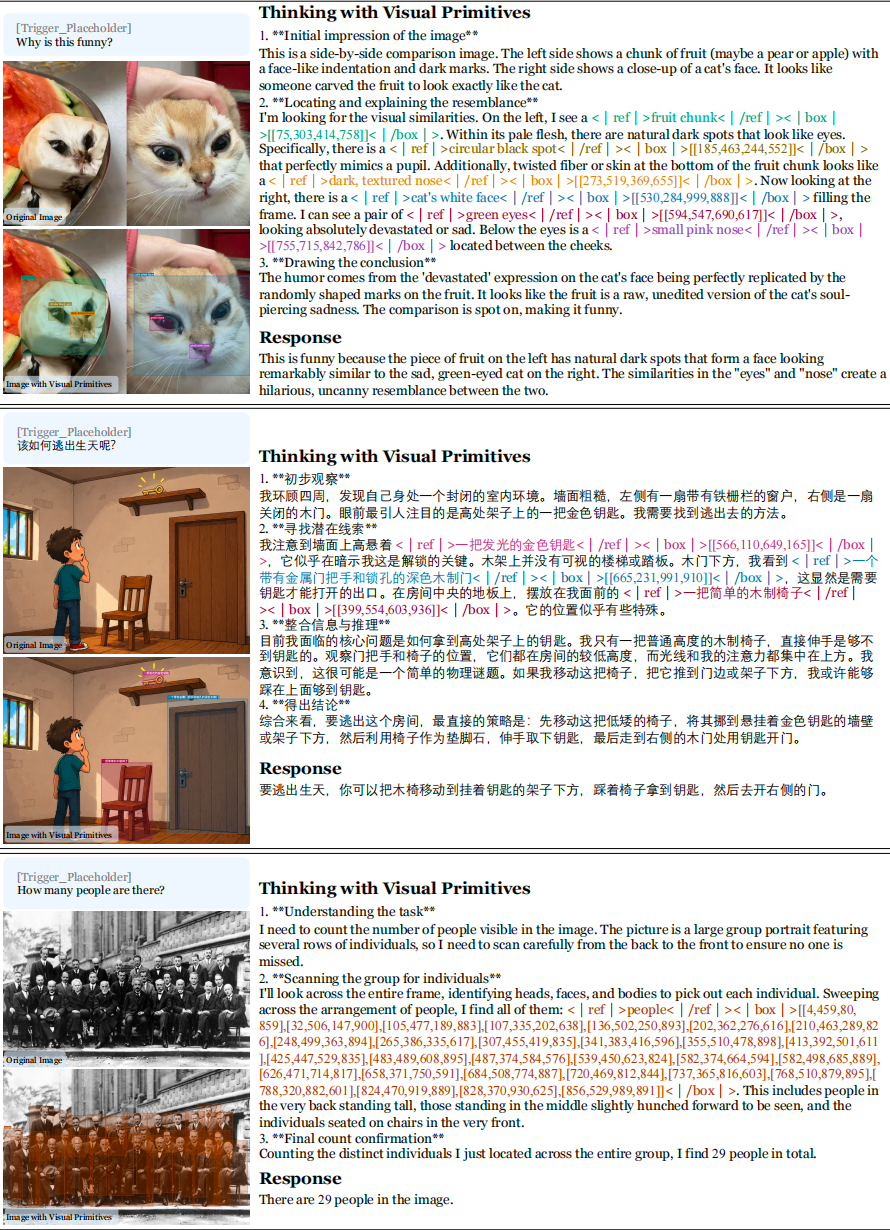

논문에서 더 많은 사례 참조:

미로 탐색: 다른 사람이 동전을 던집니다, DeepSeek 실제로

를 검색하는 중입니다. 논문에서 4가지 작업을 테스트했는데 미로가 가장 넓은 것이었습니다. 격차.

작업은 매우 간단합니다. 미로 도표가 주어지면 시작점에서 끝점까지의 경로가 있는지 묻고, 그렇다면 경로를 그립니다. 미로는 정사각형, 고리형, 벌집형의 세 가지 모양이 있습니다.

모델이 미로를 탐색하는 방식은 어렸을 때 연필을 사용하여 종이에 그림을 그릴 때와 동일합니다. 분기 경로를 선택하고 끝까지 이동합니다. 작동하지 않으면 돌아가서 다른 것을 시도하십시오. 차이점은 걸을 때마다 지도에 좌표점을 표시하고 기록을 남긴다는 점이다.

이 논문은 원형 미로의 전체 과정을 보여줍니다. 모델은 먼저 시작점과 끝점을 표시한 다음 탐색을 시작합니다. 18걸음을 걷고 막다른 골목에 두 번 들어갔다가 빠져나왔다. 마지막으로 경로를 찾아 전체 경로의 좌표점을 연결하여 출력했습니다.

DeepSeek는 또한 일련의 함정 미로를 설계했습니다. 언뜻 보기에는 경로가 있지만 중간의 특정 섹션이 비밀리에 차단되어 있습니다. 이런 종류의 미로는 인내심을 시험합니다. 모델은 시작점 근처의 추세만 보는 것만으로는 결론을 도출할 수 없습니다. 작동하지 않는지 확인하려면 가능한 모든 경로를 시도해야 합니다.

정확도 비교:

- DeepSeek: 66.9%

- GPT-5.4: 50.6%

- Claude-Sonnet-4.6: 48.9%

- Gemini-3-Flash: 49.4%

- Qwen3-VL: 49.6%

미로에 대한 답은 두 가지뿐입니다. 길이 있는 것과 없는 것입니다. 무작위 추측은 정확히 50%입니다. GPT, Claude, Gemini, Qwen은 모두 50% 안팎을 맴돌고 있는데, 이는 동전 던지기와 다르지 않습니다. DeepSeek의 66.9%는 높지 않지만 실제로는 바보 심부름이 아닌 단계별 접근 방식입니다.

경로 추적: 모두가 결함을 찾는 최고의 버전

이 작업은 더 직관적입니다. 여러 개의 스레드가 서로 얽혀 있고 각 스레드는 한 마커에서 다른 마커로 이어집니다. 헤드폰 코드를 주머니에서 꺼냈을 때의 모습은 사진과 같습니다. 질문은 다음과 같습니다. 이 선은 어느 끝점으로 연결됩니까?

모델은 손가락이 종이를 교차하는 것처럼 선을 따라 좌표점을 출력하는 모델입니다. 선이 급격하게 구부러진 부분에는 점들이 촘촘하게 표시되고 직선 부분은 드물게 표시됩니다. 사람들이 눈으로 선을 따라갈 때도 마찬가지다. 곡선에서는 속도가 느려지고 직선에서는 스윕됩니다.

이 논문은 또한 테스트의 어려운 버전을 추가합니다. 모든 선은 동일한 색상과 두께입니다. 더 이상 색상으로 어떤 선인지 구분할 수 없으며 교차점이 따라야 하는 선을 결정하기 위해 곡선 자체의 추세 연속성에 의존할 수 있습니다.

- DeepSeek: 56.7%

- GPT-5.4: 46.5%

- Claude-Sonnet-4.6: 30.6%

- Gemini-3-Flash: 41.4%

Claude의 30.6%는 조금 의외입니다. 일반적으로 종료점에는 4~5개의 옵션이 있으며 무작위 추측은 20% 이상이어야 하며 30.6%는 블라인드 추측보다 약간 더 나을 뿐입니다. 아마도 언어적 추론의 관성은 이러한 유형의 순수 공간 추적 작업에는 도움이 되지 않을 것입니다.

AI를 가르치는 방법 부정 행위 없이 미로 걷기

미로 훈련에는 실질적인 문제가 있습니다. 최종 답이 맞는지 아닌지에 따라 점수만 매기면 모델이 빨리 학습합니다. 열심히 찾아보고 틀린 답을 얻기보다는 그냥 추측해 보는 것이 더 좋습니다. 어쨌든, 신중하게 질문에 올바르게 대답하면 점수는 0이 됩니다.

DeepSeek의 솔루션은 해당 과정을 악보에 포함시키는 것입니다. 합법적인 탐험의 모든 단계에서 포인트가 주어지고, 벽을 통과할 때마다 포인트가 차감되며, 더 멀리 갈수록 더 좋습니다. 마지막에 결승선에 도달하지 못하더라도 대부분의 지역을 주의 깊게 검색하면 좋은 결과를 얻을 수 있습니다. 이렇게 하면 모델이 게으를 이유가 없습니다.

풀 수 없는 미로에는 더 높은 요구 사항이 있습니다. "안 돼요"라고만 말할 수는 없으며 갈 수 있는 모든 장소를 실제로 방문했다는 것을 증명해야 합니다. 검색 범위도 중요합니다.

이스터 에그 1개, 제한 3개

훈련 데이터에 중국어가 없습니다. 하지만 이 모델은 중국어로 시각적 원시 추론을 할 수 있습니다.

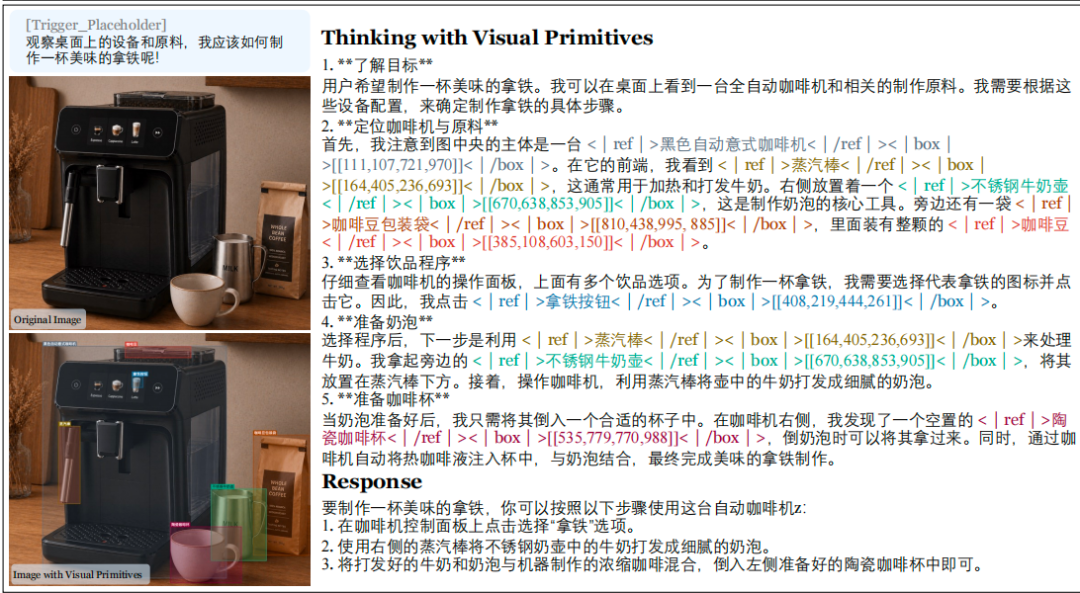

커피 머신 사진을 보여주고 중국어로 "라떼 만드는 법"이라고 물어보세요. 스팀완드, 우유포트, 커피원두, 라떼버튼의 위치좌표를 중국어로 표기하고 작동단계를 알려줍니다. 다국어 기능은 기본 모델에서 상속되며 시각적 기본 요소에 대한 교육으로 인해 파괴되지 않습니다.

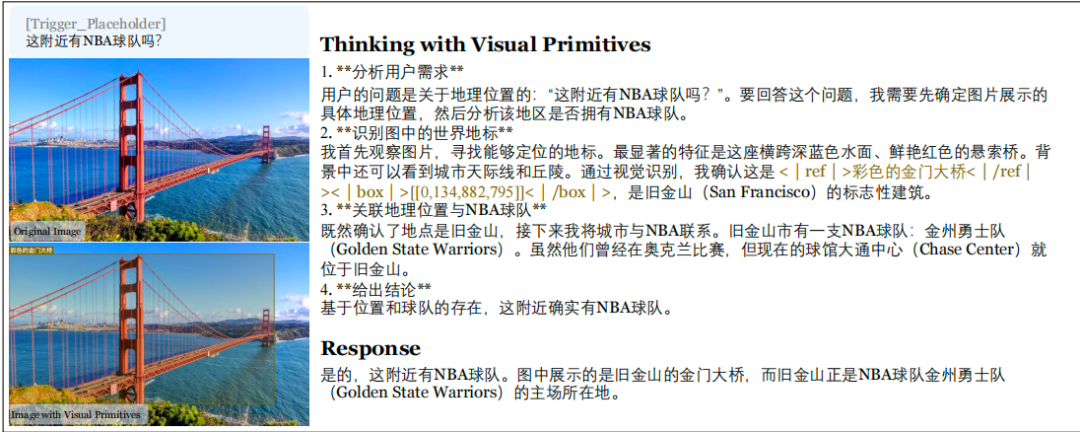

또한 사진 보기와 세계 지식을 결합할 수도 있습니다. 금문교 사진을 제공하고 "근처에 NBA가 있나요?"라고 질문하면 됩니다. 팀?" 골든 게이트 브리지의 프레임을 설정하고 샌프란시스코라고 추론한 다음 골든 스테이트 워리어스에게 응답했습니다.

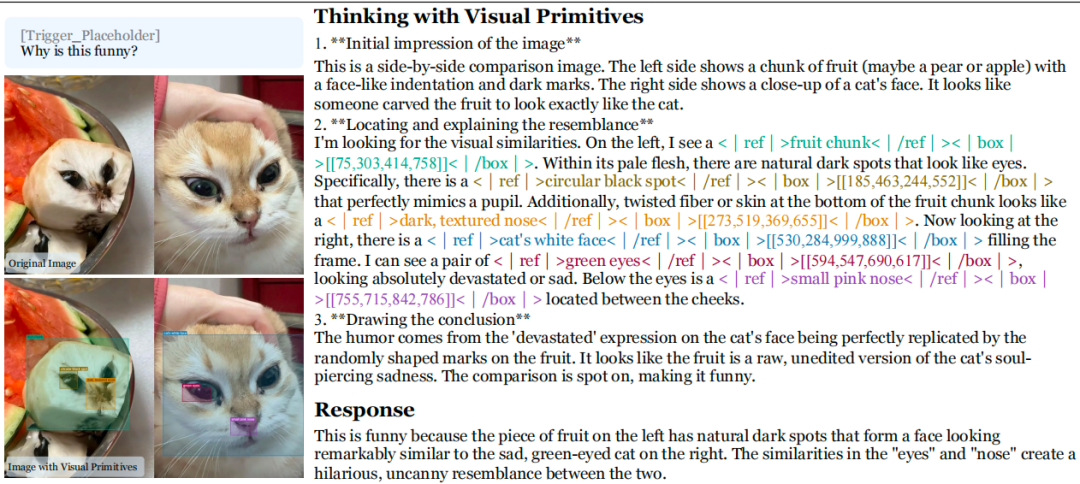

는 유머를 이해할 수 있습니다. 잘린 과일 조각의 자연스러운 반점이 정확히 슬픈 고양이의 얼굴을 구성하고 모델이 이를 지적할 수 있습니다.

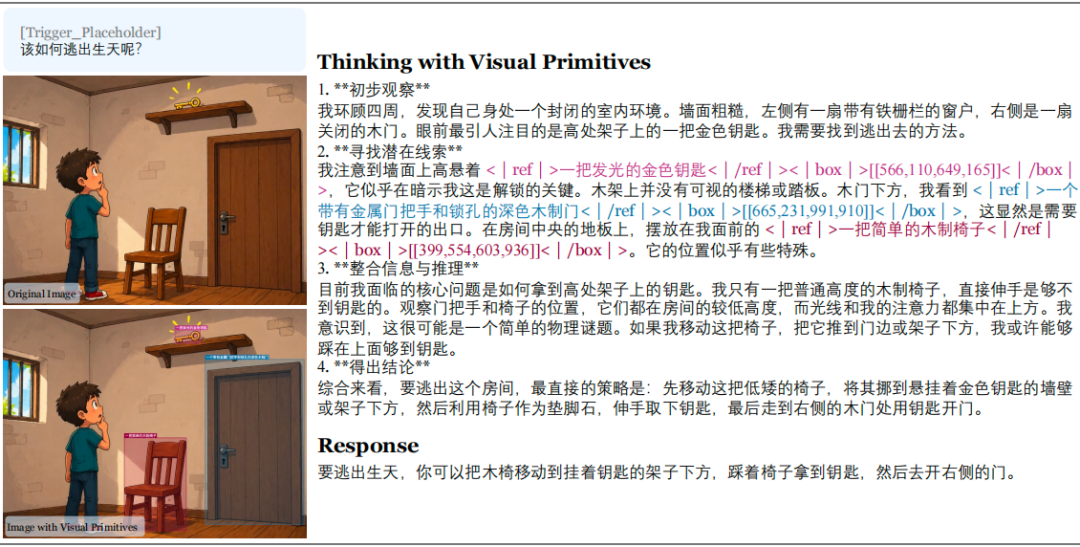

탈출실 안내를 제공할 수 있습니다. 열쇠를 높은 곳에 두고, 의자를 바닥에 두고, 문을 잠그고, "의자를 열쇠 아래로 옮기고 → 의자를 밟아 열쇠를 얻고 → 문을 엽니다"라고 제안합니다.

이 논문은 현재 불가능한 것에 대해 솔직하게 적고 있습니다.

입력 해상도가 제한되어 있습니다. ViT 출력이 81과 384 시각 정보 단위 사이에서 멈췄습니다. 매우 상세한 장면(예: 손가락 세기 등)을 접할 때 좌표 정확도가 충분하지 않습니다. 전날 실제 테스트에서 손가락으로 숫자를 세다가 차가 전복된 직접적인 이유가 여기에 있을 것으로 보인다.

현재 시각적 기본 모드를 활성화하려면 특정 트리거 단어가 필요합니다. 모델은 아직 "이 문제를 해결하려면 손가락을 뻗어야 한다"고 판단할 수 없으며 누군가가 이를 상기시켜 주어야 합니다.

위상 추론에는 일반화 기능이 제한되어 있습니다. 훈련된 미로 유형에서는 효과가 좋지만 새로운 공간 구조로 변경하면 효과가 떨어질 수 있습니다. Chen Xiaokang은 삭제된 트윗에서 다음과 같이 말했습니다.

"우리는 아직 초기 단계에 있습니다. 복잡한 위상 추론 작업의 일반화는 아직 완벽하지 않지만 이를 해결하기 위해 최선을 다하고 있습니다."

“우리는 아직 초기 단계에 있으며 복잡한 위상 추론 작업의 일반화는 아직 완료되지 않았지만 계속해서 노력할 것입니다.

엊그제 실제 테스트에서 DeepSeek의 이미지 인식 모드(출판사의 신원을 묻는 Lenovo 고래 로고)에서 보여준 기능은 자체 교정, 스스로 "소형 방어 회의" 제공)가 본 논문에서 설명하는 사고 방식과 일치합니다. 뇌에 시각적인 기준점을 설정하고, 기준점을 중심으로 추론을 하고, 갈등이 생기면 다시 돌아가 이를 바로잡는다.

손가락을 세다 보면 현기증이 납니다. 이것이 바로 Reference Gap의 생생한 시연입니다. 손가락이 겹친 그림에서 순전히 말로만 의존하여 '왼쪽에서 세 번째'와 '오른쪽에서 두 번째'를 구별하는 것은 손가락을 펴지 않고 모여 있는 사람들의 수를 세는 것과 같아서 혼란에 빠질 수밖에 없다.

이 논문이 가리키는 방향은 다음과 같습니다. 다중 모드 추론의 다음 진화는 앵커링 메커니즘에 있습니다. DeepSeek은 90개의 정보 단위를 사용하여 수천 개의 토큰을 사용하는 다른 사람의 효과와 동일하며, 절약된 모든 컴퓨팅 파워는 모델이 "동시에 생각하고 지적"할 수 있도록 하는 데 사용됩니다.

모델에 더 비싼 안경을 맞추는 대신 손가락을 내밀도록 교육하면 해상도 군비 경쟁을 조금 늦출 수 있습니다.

고래는 눈을 뜬 후 손가락도 자랐습니다. 66.9%의 미로 정확도는 완벽과는 거리가 멀지만, 적어도 동전을 던지는 옆집 아저씨들과는 달리 진지하게 받아들이는 수준이다.