최신 AI 이미지 생성기는 빠르게 진화하고 있으며 변형된 손과 발, 지저분한 텍스트, 이상한 그림 노이즈 등 초기에 한눈에 보였던 결함이 점차 엔지니어링 수단을 통해 다듬어지고 있습니다. 요즘에는 일반 사람들의 육안을 속이고 소셜 미디어에 걷잡을 수 없이 퍼져나가기에 충분한 합성 이미지가 많이 있습니다. 그러나 사이언스(Science) 저널에 발표된 연구에 따르면 이러한 모델은 여전히 빛과 기하학이 현실 세계에서 어떻게 작동하는지 본질적으로 "이해하지 못하고" 있으며 물리적 법칙은 진짜 이미지와 가짜 이미지를 식별하는 가장 신뢰할 수 있는 도구 중 하나가 되고 있다고 지적합니다.

연구원들은 반사, 그림자, 투시선 등 사소해 보이는 부분까지 측정한다면 완벽해 보이는 AI 사진을 공개할 가능성은 여전히 있다고 지적했다. 물리적 세계의 일관성에 기반한 이러한 검증 방식은 디지털 포렌식 전문가들이 '딥페이크' 시대에 인공지능 위조품과 실제 사진을 구별하는 중요한 방어선으로 평가받고 있다. 초기 식별은 대개 육안으로 거친 기술적 결함을 포착하는 데 의존했지만 제작 품질이 향상됨에 따라 이미지는 "현실"에 대한 인간의 주관적인 기대(밝은 색상, 극적인 구성, 영화적 느낌으로 가득 차 있음)에 점점 더 부합하기 시작했습니다. 이 '제작 드라마'는 사람들의 경계심을 더 쉽게 풀어주었다.

UC Berkeley 교수이자 디지털 포렌식 분야의 창시자 중 한 명으로 널리 알려진 Hany Farid는 AI 이미지의 또 다른 '숨겨진 약점'을 악용해 왔습니다. 그의 접근 방식은 명백한 시각적 오류를 찾는 것이 아니라 생성된 이미지를 실제 세계에 나타나야 하는 기하학적 관계와 비교하는 것입니다. 그의 의견으로는 기존 이미지 생성 모델은 아직 미술 수업에서 기본 개념인 소실점을 제대로 배우지 못한 것 같습니다.

AI가 생성한 "복도에서 행진하는 군인" 사진을 예로 들어보세요. 벽에 있는 흐릿하고 읽기 어려운 텍스트, 설명할 수 없는 사슬 등과 같은 몇 가지 명백한 결함을 그림에서 볼 수 있습니다. 그러나 더 중요한 단서는 바닥의 타일에 숨겨져 있습니다. 원근법의 원리에 따르면 현실의 평행선(예: 바닥 타일 및 나무 바닥의 이음새)은 확장되어 그림의 동일한 소실점으로 수렴해야 합니다. 선 도구를 사용하여 이러한 구조물을 따라 선을 그리면 실제 사진처럼 멀리서 만나는지 확인할 수 있어 이미지가 신뢰할 수 있는지에 대한 초기 감각을 얻을 수 있습니다.

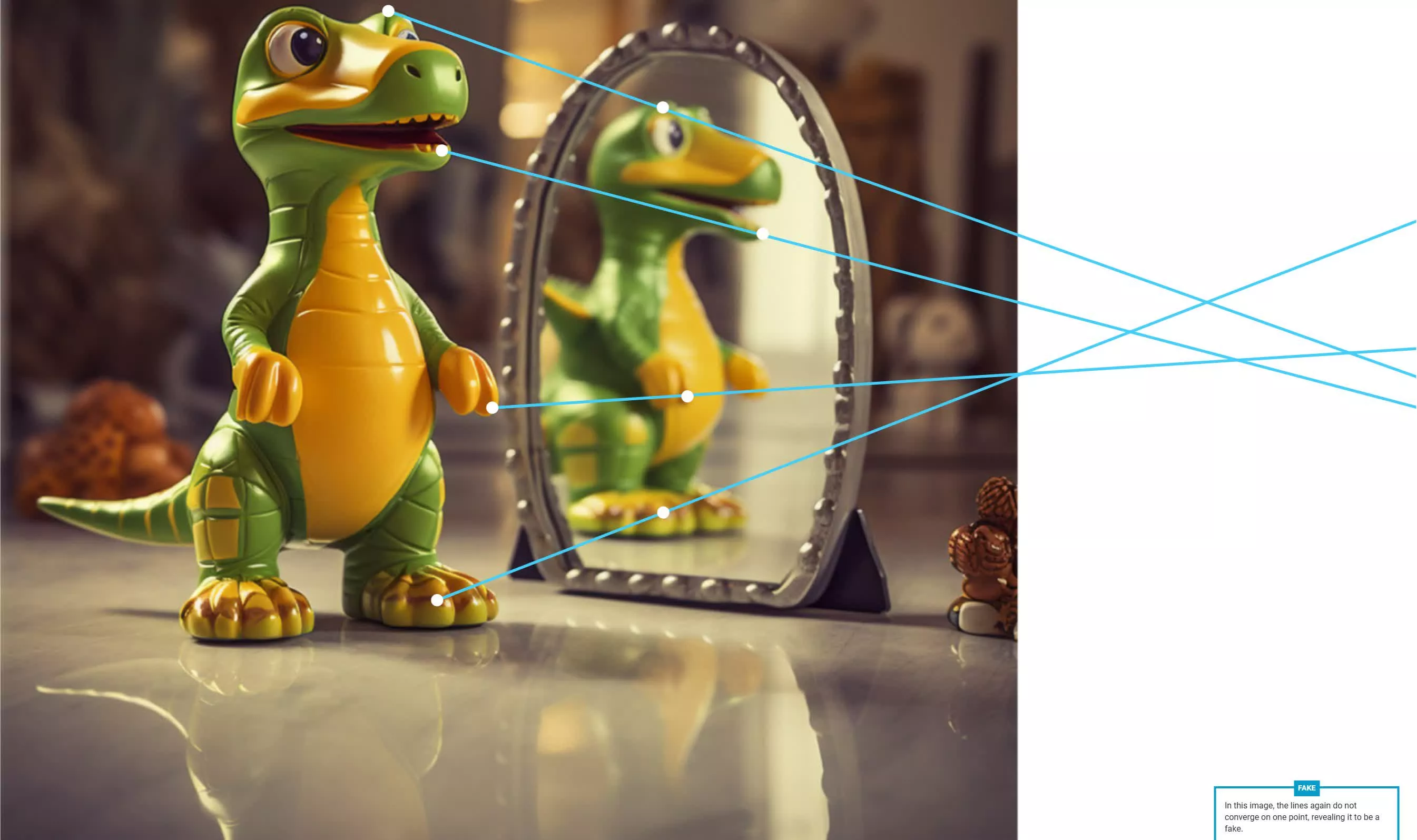

비슷한 기하학적 관계가 반사에도 적용됩니다. 연구에 따르면 오늘날의 생성 모델은 이미 인간의 눈을 속이기에 충분한 물이나 정반사를 합성할 수 있지만, 이를 측정하기 위해 자를 사용하는 한 문제가 노출될 것이라고 지적합니다. 현실 세계에서는 물체의 특정 지점과 그에 대응하는 반사 지점을 연결하는 선이 서로 평행해야 하며 연장된 후에도 동일한 소실점을 가리켜야 합니다. 이러한 선에 과도한 편차가 있는 것으로 나타나면 이는 합성 이미지임을 의미할 가능성이 높습니다.

태양에 의해 드리워진 그림자는 이러한 유형의 테스트에 추가적인 그립력을 제공합니다. 태양은 지구에서 매우 멀리 떨어져 있기 때문에 땅에 닿는 태양광은 대략 평행광이라고 생각할 수 있습니다. 이 전제 하에서 물체의 특정 지점과 그림자의 해당 지점 사이의 선도 연장되어 소실점으로 수렴할 수 있어야 합니다. 사진 속 다양한 물체의 그림자 선이 일관된 기하학적 관계를 가리킬 수 없다면 광학의 기본 법칙을 위반할 가능성이 높습니다.

생성 모델이 이러한 물리적 수준의 오류를 근본적으로 극복할 수 있는 시기와 여부를 현재로서는 예측하기 어렵습니다. 초기에는 육안으로 쉽게 식별할 수 있었던 결함에 비해 관점과 빛을 기반으로 한 '기하학적 검증'은 관찰자가 더 많은 시간과 에너지를 소비해야 하며 이는 일반 소셜 미디어 사용자의 일일 경계 임계값을 훨씬 초과합니다. 일부 연구자들은 그러한 물리적 규칙을 깊이 이해하는 것이 현재 주류 생성 모델의 설계 능력을 넘어설 수 있다고 믿습니다.

이 작업 외에도 전문가들은 "AI를 사용하여 AI를 식별하는 것"에 대해 사용자에게 주의를 당부합니다. 일부 자동 감지 도구는 실제로 특정 조건에서 훈련되지 않은 사람의 눈보다 더 신뢰할 수 있지만 입력 이미지와 해당 훈련 데이터의 분포가 너무 다르면 알고리즘에 오류가 발생하고 시스템적 편향이 발생할 수도 있습니다. 즉, 심사 업무를 완전히 다른 블랙박스 모델에 넘기는 것은 완벽한 해결책이 아니다.

관련 연구에서도 흥미로운 발견이 있었습니다. 사진이 '진짜'인지 확인하는 것이 '가짜' 사진을 식별하는 것보다 더 어려울 수 있다는 것입니다. 연구 결과, 결함을 발견하지 못한 채 이미지를 오랫동안 관찰할수록 실제 사진일 가능성이 더 높아진다는 사실이 밝혀졌습니다. 이런 관점에서 보면 '오류가 발견되지 않았다'는 것 자체가 진정성의 증거 중 하나가 될 수 있다.