엔비디아는 차세대 AI 플래그십 플랫폼 베라 루빈(Vera Rubin)의 출시를 가속화하고 있습니다. 최신 뉴스에 따르면 플랫폼은 이르면 올해 7월부터 북미 주요 클라우드 서비스 및 AI 고객에게 배송을 시작하고 2026년 하반기에 본격적인 양산에 들어갈 예정이다. Vera Rubin의 디자인 및 사양에 문제가 있다는 이전 소문은 이제 새로운 생산 및 배송 일정에 의해 기본적으로 부인되었습니다.

며칠 전 업계에는 베라 루빈의 디자인과 사양에 조정이 있을 수도 있고 심지어 문제가 있을 수도 있다는 소식이 돌았는데, 이는 블랙웰 GPU 서버가 출시 전 겪은 소란과 비슷하다는 평가다. 하지만 엔비디아는 공급망 파트너들과 함께 차세대 AI 랙과 서버를 납품하며 쌓은 경험을 바탕으로 양산 전 기술적 결함을 빠르게 해결하는 능력을 다시 한번 입증했다. 업계 체인 소식통을 인용한 대만 '경제일보'의 보도에 따르면 엔비디아는 ODM 파트너들과 함께 베라 루빈의 최종 양산 버전을 마무리하고 명확한 도입 리듬을 설정했다고 지적했습니다.

이 보고서에 따르면 엔비디아는 올해 6월 베라 루빈 플랫폼의 시험 생산을 시작할 예정이며, 이후 7월부터 첫 번째 서버 배치가 북미의 여러 대규모 클라우드 서비스 제공업체와 AI 데이터 센터 고객에게 배송될 예정입니다. 첫 번째 고객 목록에는 Microsoft, Google, Amazon, Meta 및 Oracle이 포함됩니다. Nvidia는 다가오는 Computex 2026 기조연설에서 Vera Rubin을 중심으로 한 클라우드 거대 기업과의 심층적인 협력을 강조할 가능성이 높습니다. 보고서는 또한 TSMC가 올해 초 3nm 공정을 시작하여 Vera Rubin 칩의 대량 생산을 시작했으며 Foxconn, Quanta, Wistron과 같은 파운드리 파트너는 올해 하반기부터 완전한 기계 및 프레임 생산을 본격화하고 이르면 2026년 3분기에 대규모 출하를 달성할 것이라고 언급했습니다.

최종 생산 사양에 대한 자세한 내용이 정리됨에 따라 Vera Rubin 플랫폼이 상당한 설계 또는 사양 변경을 겪을 수 있다는 이전 진술은 "사실과 일치하지 않거나 이후에 수정된 초기 정보를 기반으로 한" 것으로 간주됩니다. 업계에서는 각 Vera Rubin AI 서버 랙의 비용이 약 1억 8천만 달러에 달하는 것으로 추정합니다. 이번 플랫폼을 통해 엔비디아의 글로벌 AI 인프라 시장 진출 잠재력은 1조달러 수준에 이를 것으로 예상된다. 이는 이익 마진을 크게 확대할 뿐만 아니라 스토리지 및 메모리 공급업체를 포함한 파트너에게 새로운 성장 모멘텀을 제공할 것입니다.

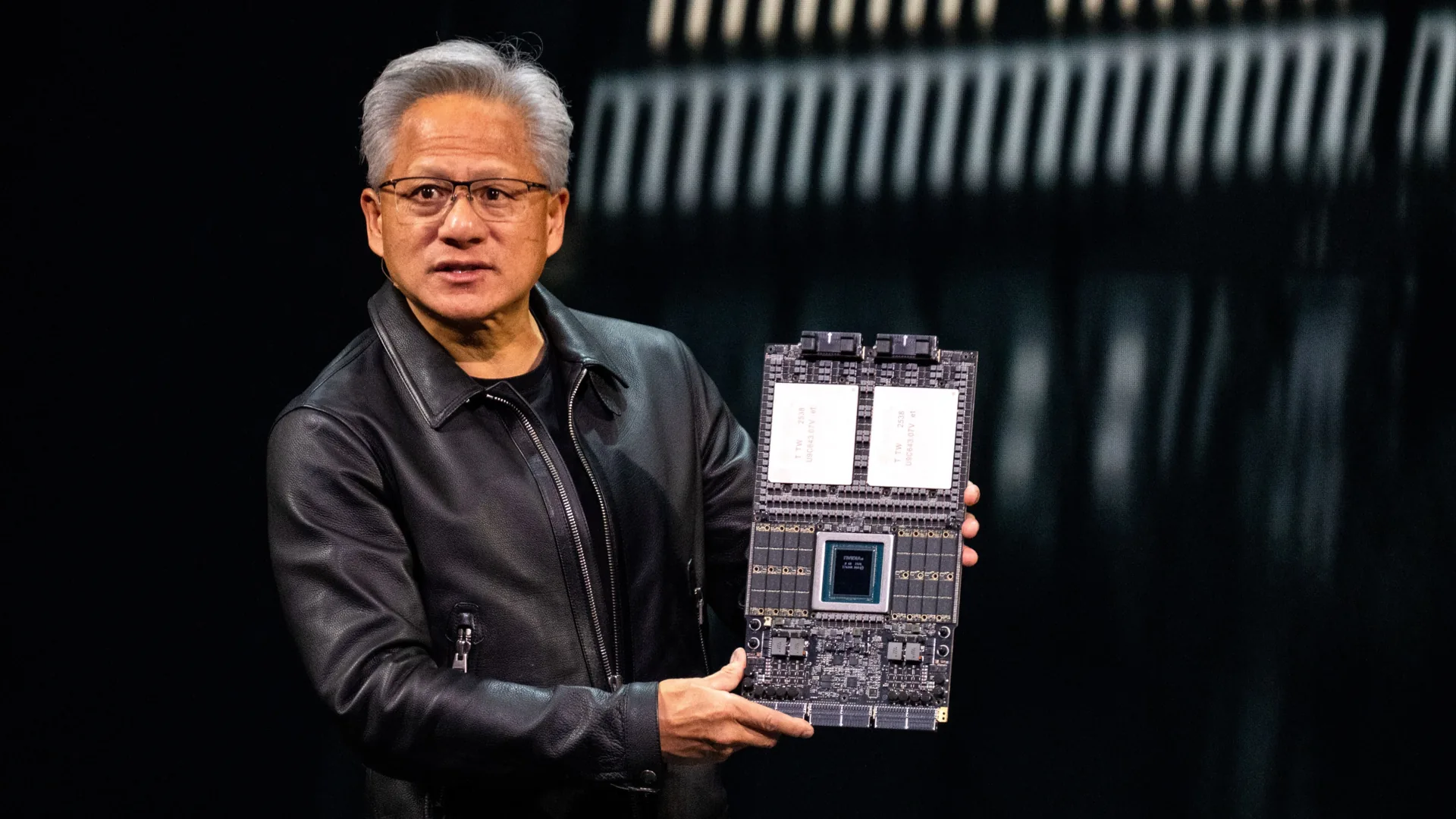

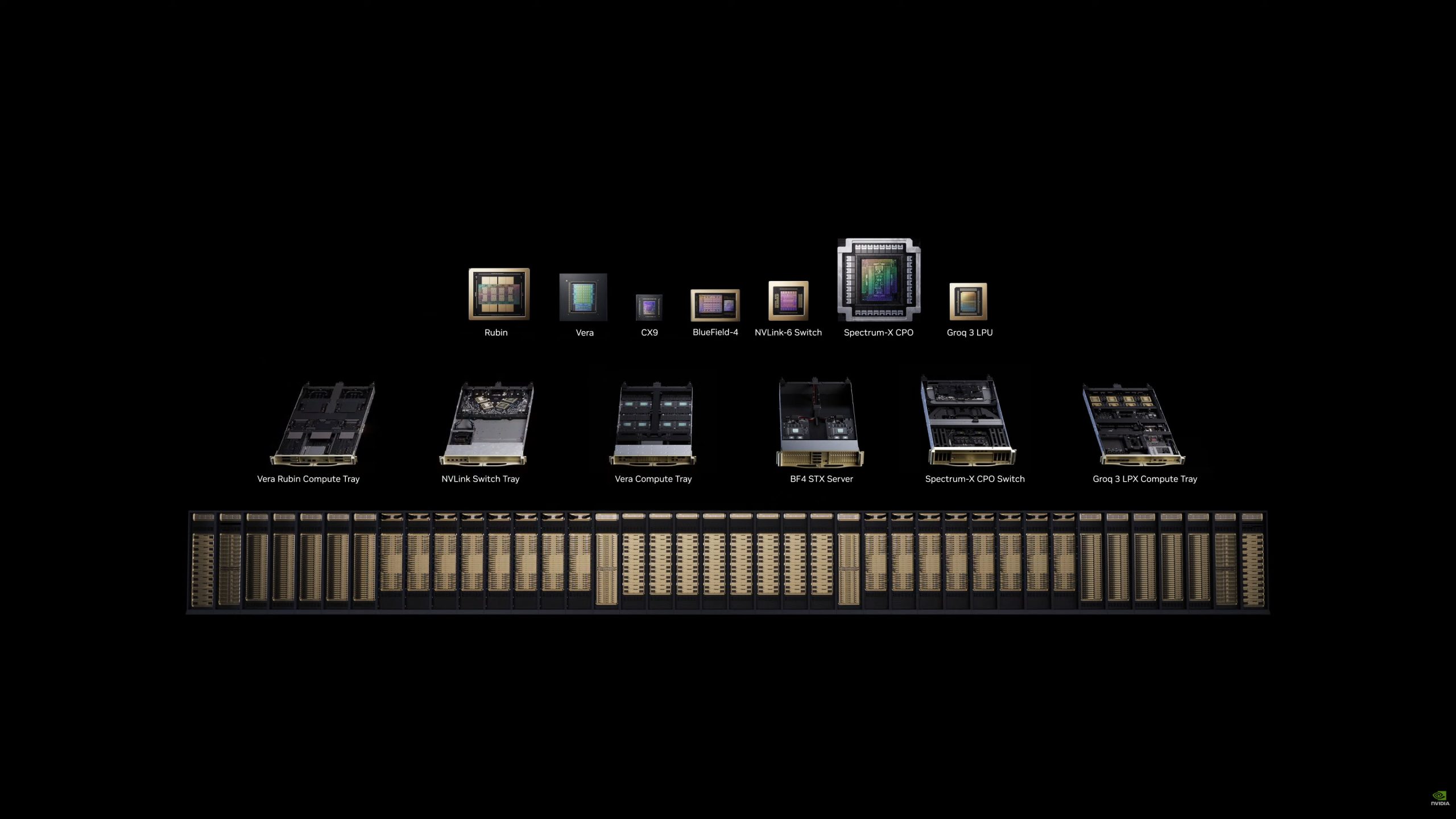

Vera Rubin 플랫폼을 중심으로 칩과 메모리 생태계가 동시에 업그레이드되고 있습니다. 파트너 제조업체는 Rubin GPU를 위한 차세대 HBM4 고대역폭 메모리를 도입하는 동시에 대규모 모델 훈련 및 추론에서 점점 더 엄격해지는 대역폭 및 용량 요구를 충족하기 위해 CPU 측에서 최대 256GB의 용량을 갖춘 SOCAMM2 LPDDR5X 솔루션을 제공할 계획입니다. 하드웨어 아키텍처 수준에서 Vera Rubin은 강력한 소프트웨어 스택의 지원을 받는 7개의 칩으로 구성된 복잡한 플랫폼으로 설명됩니다. 업계에서는 일시적으로 독보적이라는 평가를 받고 있다. Nvidia는 Vera Rubin에 의존하여 향후 10년 내에 컴퓨팅 성능 출력을 현재 수준의 4천만 배로 늘릴 것으로 예상한다고 발표했습니다. 업계에서는 이전 기술 미리보기를 통해 일반적으로 이 플랫폼이 AI 컴퓨팅 성능에 새로운 도약을 가져올 것으로 기대하고 있습니다.

일정을 보면 베라 루빈은 루머와 불확실성에서 벗어나 본격적인 시험 제작 및 출하 단계에 진입하고 있는 것으로 전해졌다. 7월부터 북미 클라우드 서비스 제공업체 데이터 센터에 첫 번째 랙 배치가 시작되고 대만 OEM이 하반기에 전면 대량 생산에 돌입함에 따라 Vera Rubin은 AI 인프라 경쟁의 다음 단계에서 NVIDIA의 핵심 비중이 될 것이며 글로벌 클라우드 컴퓨팅 및 AI 산업 환경에도 지대한 영향을 미칠 것입니다.