DeepSeek V4가 출시된 지 불과 5일밖에 안 됐는데, 거의 매일 새로운 액션이 나오고 있습니다. 어제 연구자들은 다중 모드 기능이 나올 것이라고 예측했으며 오늘은 이미 그레이스케일 테스트가 진행되고 있습니다. 많은 사람들이 DeepSeek 웹 페이지에 사진 인식 모드가 추가되어 이미지 정보를 이해할 수 있다는 것을 발견했습니다. 이 기능이 AI의 프로그래밍 및 추론 성능을 직접적으로 향상시키지는 못하지만 사용하기 매우 편리할 것입니다. 일상생활에서 문제가 발생하면 직접 스크린샷을 업로드하고 DeepSeek이 스스로 분석하도록 할 수 있습니다. 문제를 직접 설명하는 것보다 쉽습니다.

그레이스케일에 도달한 네티즌들도 전문적인 이미지 정보를 활용하고 있다.예를 들어 DeepSeek의 영상 인식 능력을 확인하기 위해 병원에서 촬영한 CT 영상을 사용했는데, 그 결과에 충격을 받았습니다.

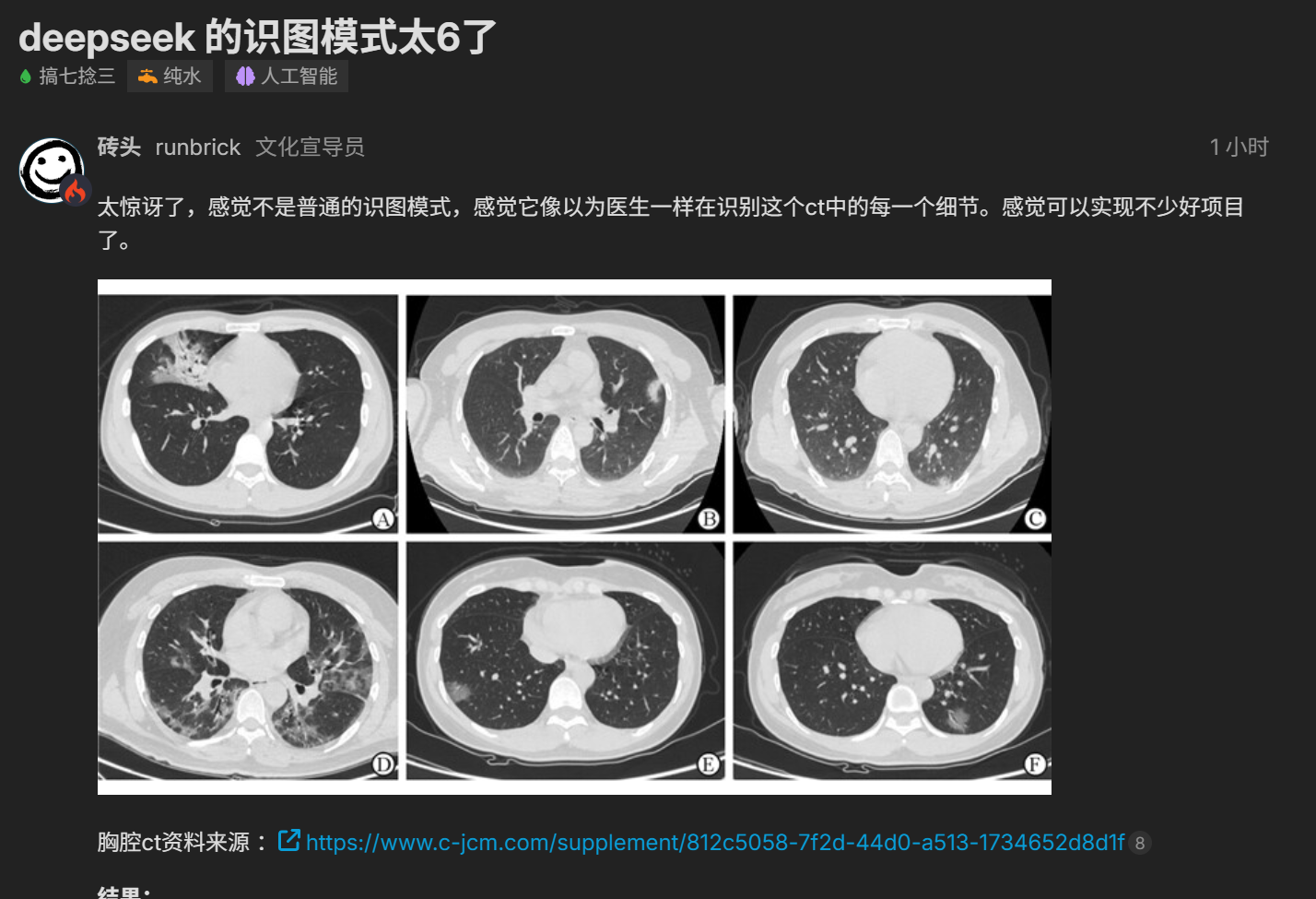

Linux.do 커뮤니티 네티즌 @brick이 업로드한 CT 이미지는 전문 논문에서 가져온 것입니다. DeepSeek에 의해 분석된 후, 이미지의 내용을 정확하게 파악하고 전문적인 분석을 수행할 수 있습니다.여러 가지 다른 유형의 폐렴 가능성을 포함하여 질병에 대한 가능한 방향을 제시하는 몇 가지 결과가 궁극적으로 생성되었습니다.

이 CT 이미지가 위치한 논문에는 명확한 결론이 나와 있습니다. 이에 비해 DeepSeek의 분석은 여전히 매우 신뢰성이 높으며 이 점에서 AI 의사의 역할을 맡을 수 있음을 알 수 있습니다.

그러나 AI는 결국 AI다. 이는 모든 사람이 상황을 분석하는 데 도움이 될 수 있습니다. 이러한 주요 건강검진과 질병의 확인에는 병원과 의사의 분석과 확인이 필요합니다.

심각한 질병이 아니라면 실제로 AI를 활용해 일반적인 의료 문제에 대한 의사가 될 수 있습니다. 대규모 전문 의료 모델이 훈련한 AI 애플리케이션도 많이 있습니다. 문제에 직면했을 때 문제를 판단하고 제안을 제공하는 데 사용하면 충분합니다. 작은 문제 때문에 병원에 가서 줄을 설 필요가 없습니다.

DeepSeek 문제로 돌아가서 이전에도 다중 모드 연구를 수행했으며 오픈 소스 OCR 기술은 심지어 세계 최고 수준에 도달했습니다. 따라서 DeepSeek V4 대형 모델의 기능 범위와 사용 제한을 더욱 향상시킬 수 있는 시각적 기능도 기대할 가치가 있습니다.