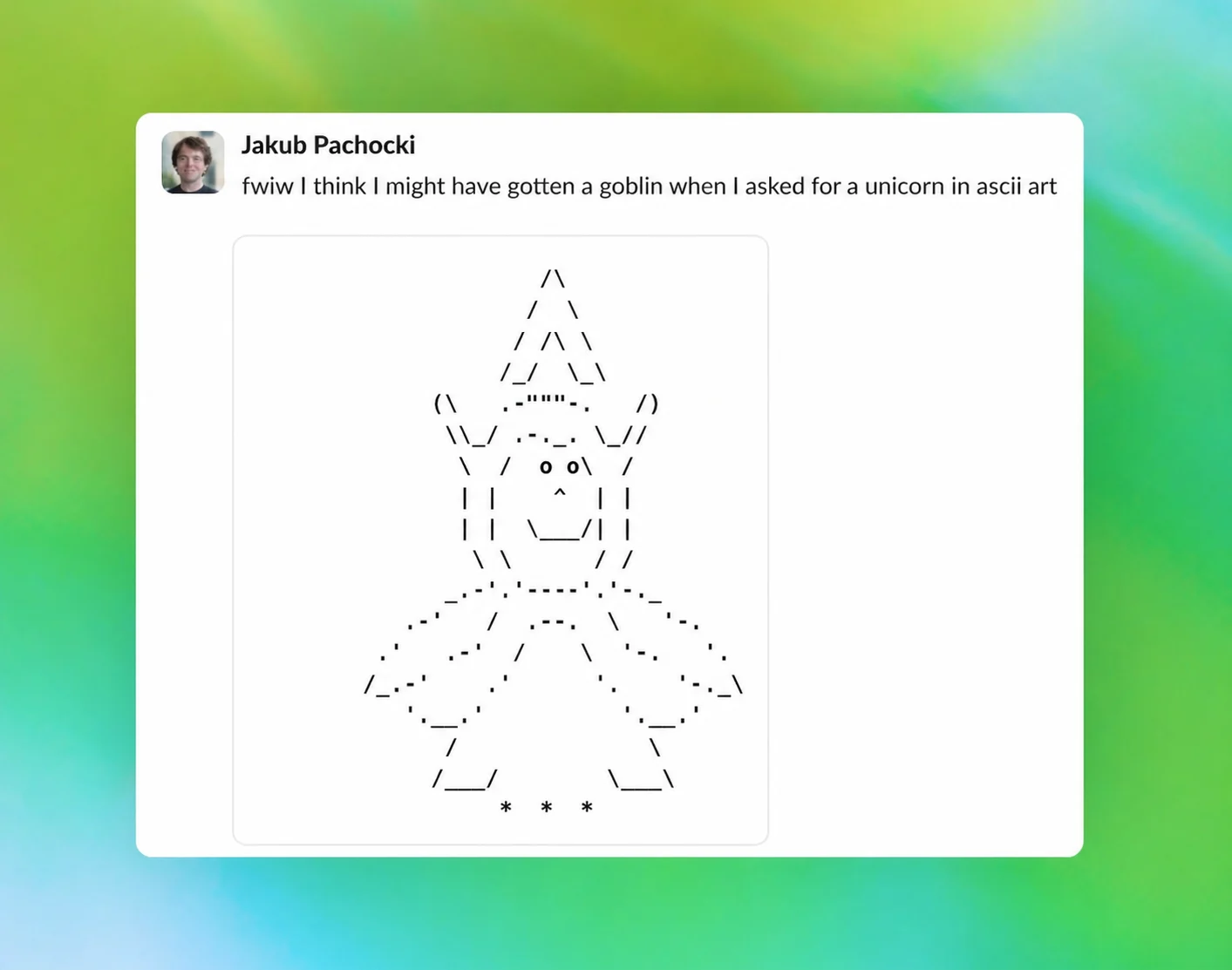

Wired가 OpenAI가 프로그래밍 모델에 "고블린, 그렘린, 너구리, 트롤, 오우거, 비둘기 또는 기타 동물이나 생물에 대해 이야기하지 마십시오"라는 내부 지침을 제공했다고 폭로한 후 OpenAI는 공식 웹사이트에 이 현상을 설명하는 기사를 게재하여 이것이 훈련 과정에서 모델에 의해 형성된 "이상한 습관"이라고 밝혔습니다.

OpenAI는 고블린 및 기타 생물과 관련된 이러한 유형의 은유적 표현이 특히 "Nerdy" 성격 옵션이 활성화된 경우 GPT-5.1 모델에서 처음으로 명확하게 발견되었다고 밝혔습니다. 회사에 따르면 후속 모델이 계속 반복되면서 이러한 표현 방식은 사라지지 않고 점차 확산되었다고 합니다.

OpenAI는 설명에서 문제의 근원이 강화 학습 훈련과 관련되어 있다고 지적했습니다. 관련 보상은 처음에는 "Nerdy" 성격 조건에서만 부과되지만 강화 학습은 학습된 행동이 이를 촉발한 조건으로 항상 엄격하게 제한된다는 것을 보장하지 않습니다. 특정 언어 스타일이나 특이한 표현이 보상되면 후속 교육 프로세스가 이를 다른 시나리오로 전파할 수 있습니다. 특히 이러한 출력이 감독된 미세 조정 또는 기본 설정 데이터 교육에 재사용되는 경우 더욱 그렇습니다. 이런 경향은 더욱 강화될 것이다.

보도에 따르면 오픈AI가 올해 3월 '너디' 성격 제공을 중단하면서 도깨비나 그렘린에 대한 이런 표현은 확실히 줄었지만 완전히 사라지지는 않았다. 특히 Codex 프로그래밍 도구에서 사용하는 GPT-5.5 모델의 경우 OpenAI가 "근본 원인"을 식별하기 전에 모델 학습을 시작했기 때문에 관련 표현이 여전히 남아 있습니다.

이 때문에 OpenAI는 궁극적으로 Codex에 매우 구체적인 제약 조건을 추가하여 이러한 신화 속 생물을 다시 언급하지 않도록 명시적으로 요구해야 했습니다. 그러나 보고서는 누군가 AI가 코드를 작성할 때 이러한 "고블린 스타일"을 약간 유지하기를 원하는 경우 OpenAI가 관련 제한을 취소하는 데 사용할 수 있는 방법을 공개적으로 공유했다고 언급했습니다.

이 반응으로 판단하면, 이 터무니없어 보이는 "고블린 문제" 뒤에는 실제로 대규모 모델 훈련의 보다 현실적인 문제가 반영되어 있습니다. 특정 성격 설정에서만 나타나야 하는 일부 언어 습관이 보상 메커니즘과 후속 훈련의 중첩 효과에 따라 더 넓은 범위의 모델 행동으로 확산될 수 있습니다. OpenAI의 경우 이는 통제 불능 모델 스타일에 대한 공개 설명일 뿐만 아니라 생성 AI의 미묘한 행동 편차를 수정할 때 직면하는 복잡성을 엿볼 수 있는 기회이기도 합니다.